全球大模型将往何处去?

在这个信息爆炸的时代,我们如同站在知识的海洋边,渴望着能够驾驭帆船,探索那些深邃的奥秘。

而今天,我们将启航,透过一份精心编制的报告,去洞察全球大模型的未来趋势,探索人工智能的无限可能。

这不仅是一次技术的巡礼,更是对未来世界的一次大胆想象。

太侠今天分享的是《全球大模型将往何处去?》,来源:华泰研究。

报告概要:

随着人工智能技术的飞速发展,大模型技术已成为推动AI进步的关键力量。华泰研究的深度报告为我们揭示了全球大模型的当前格局和未来趋势。

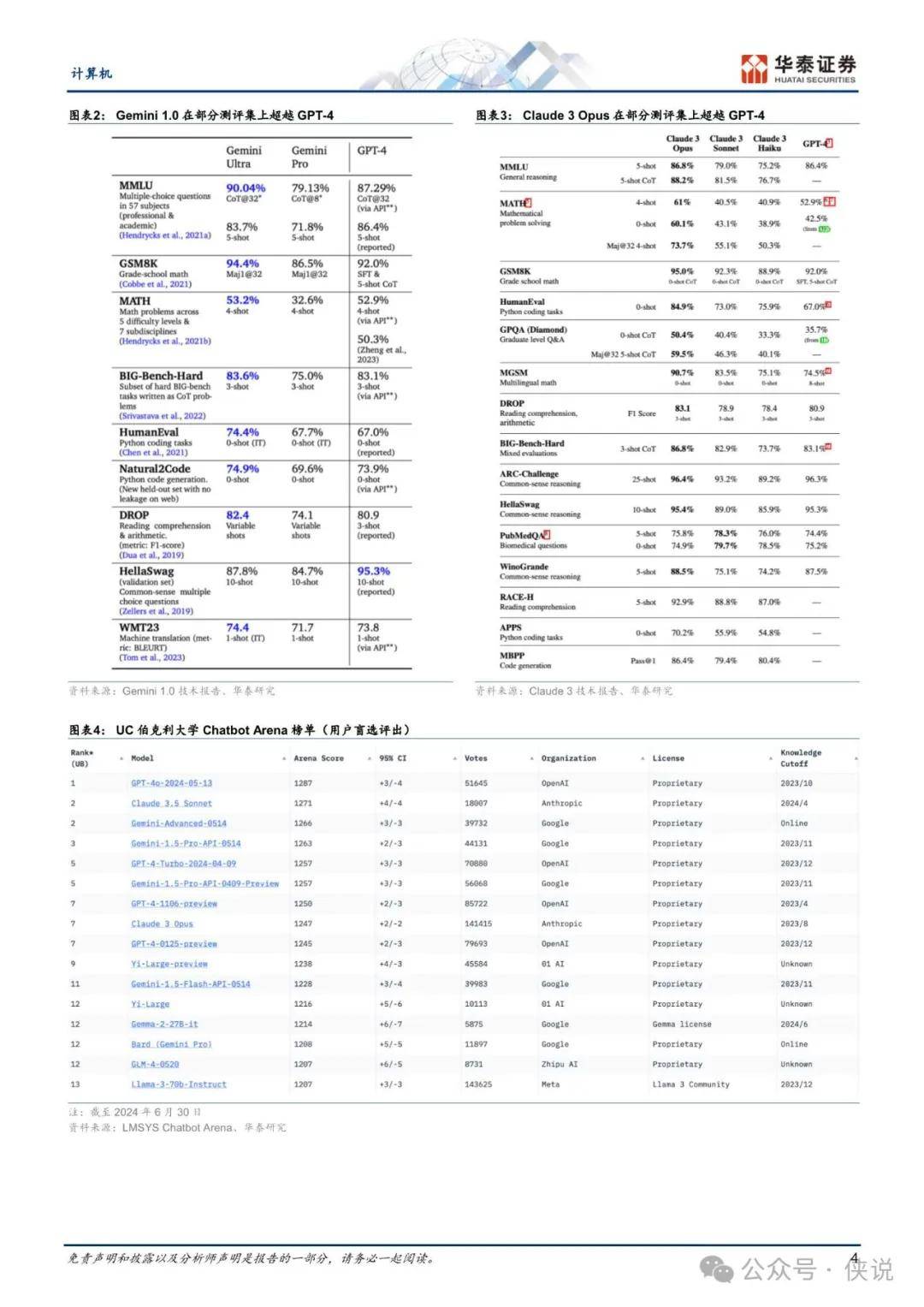

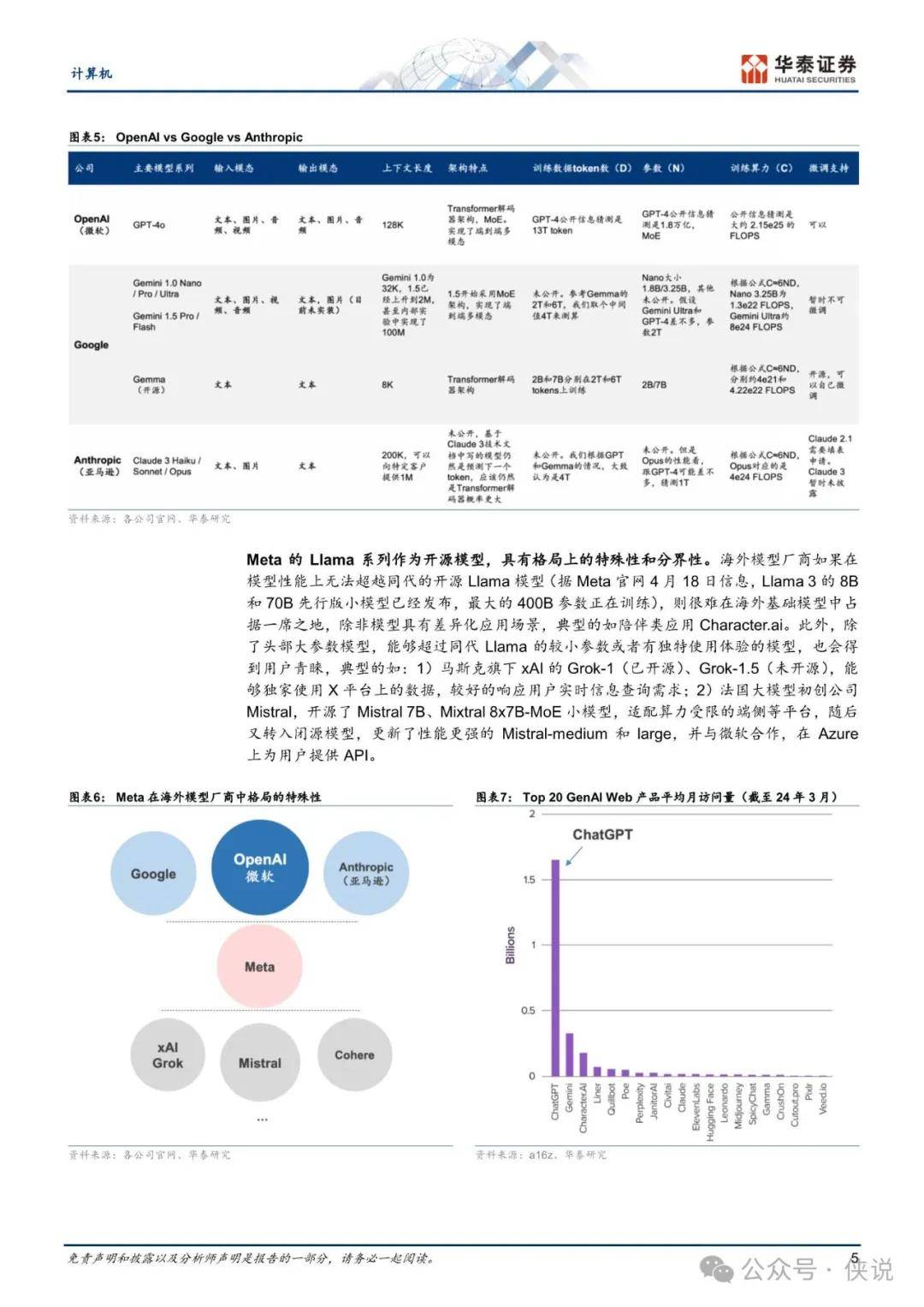

报告指出,海外市场已形成以OpenAI为首的闭源大模型竞争格局,同时Meta引领的开源模型生态也在迅速崛起。

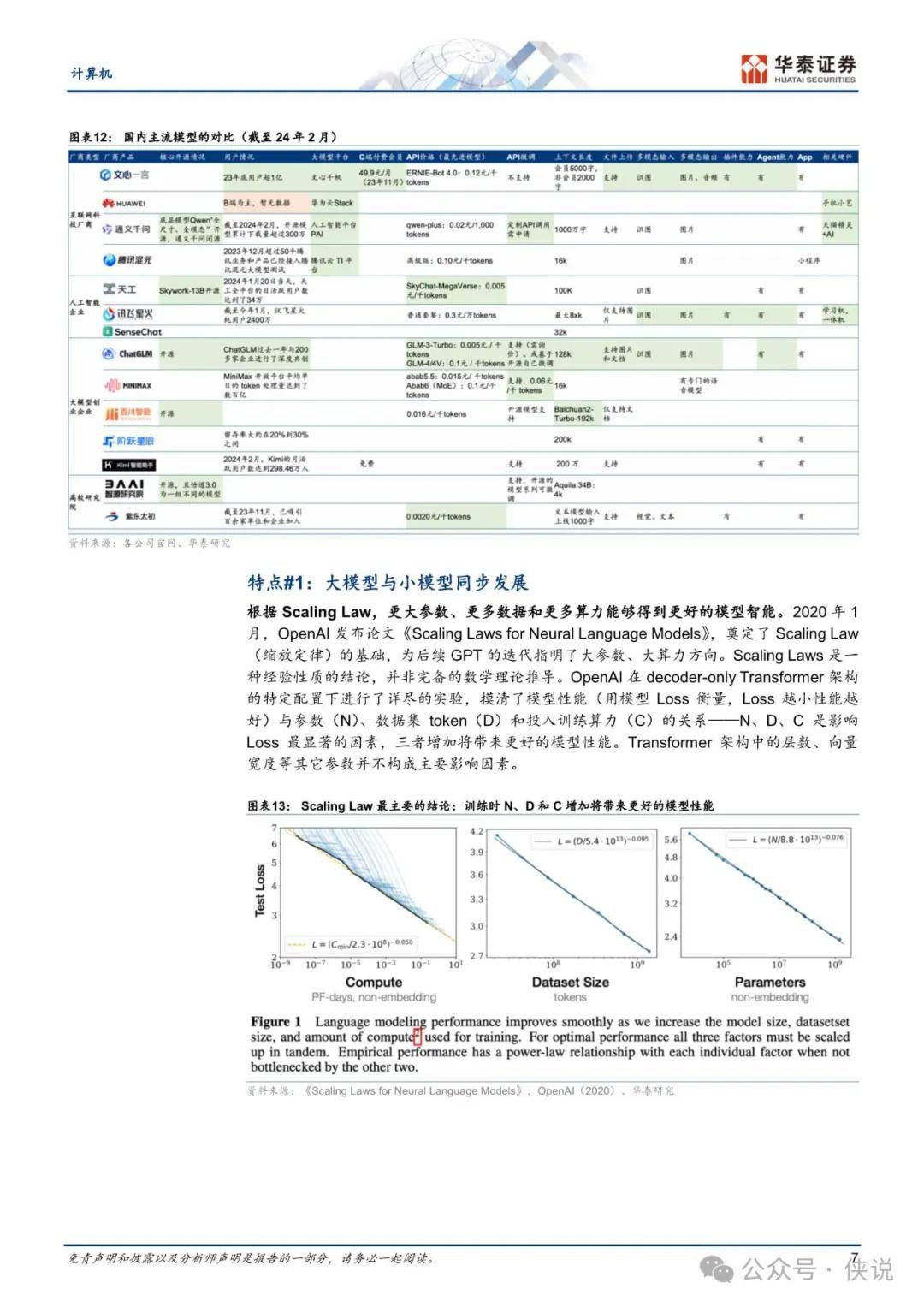

在国内市场,众多企业竞相发展,技术路线日益多元化。

报告进一步分析了多模态、长文本处理和MoE架构等技术特点,并预测了GPT-5等新一代大模型的发展方向,为我们勾勒出了AI技术发展的未来蓝图。

报告目录:

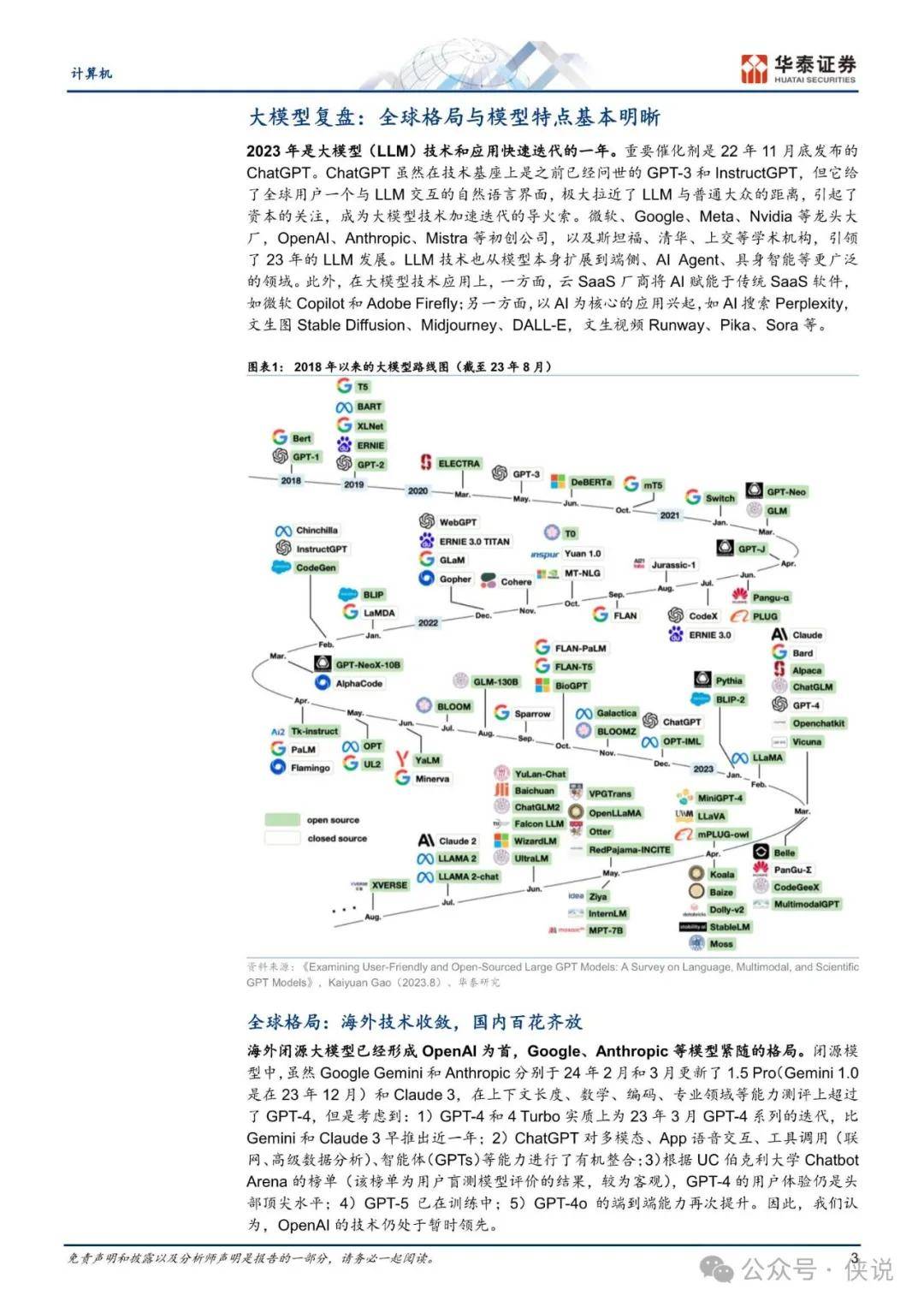

大模型复盘:全球格局与模型特点基本明晰

全球格局:海外技术收敛,国内百花齐放

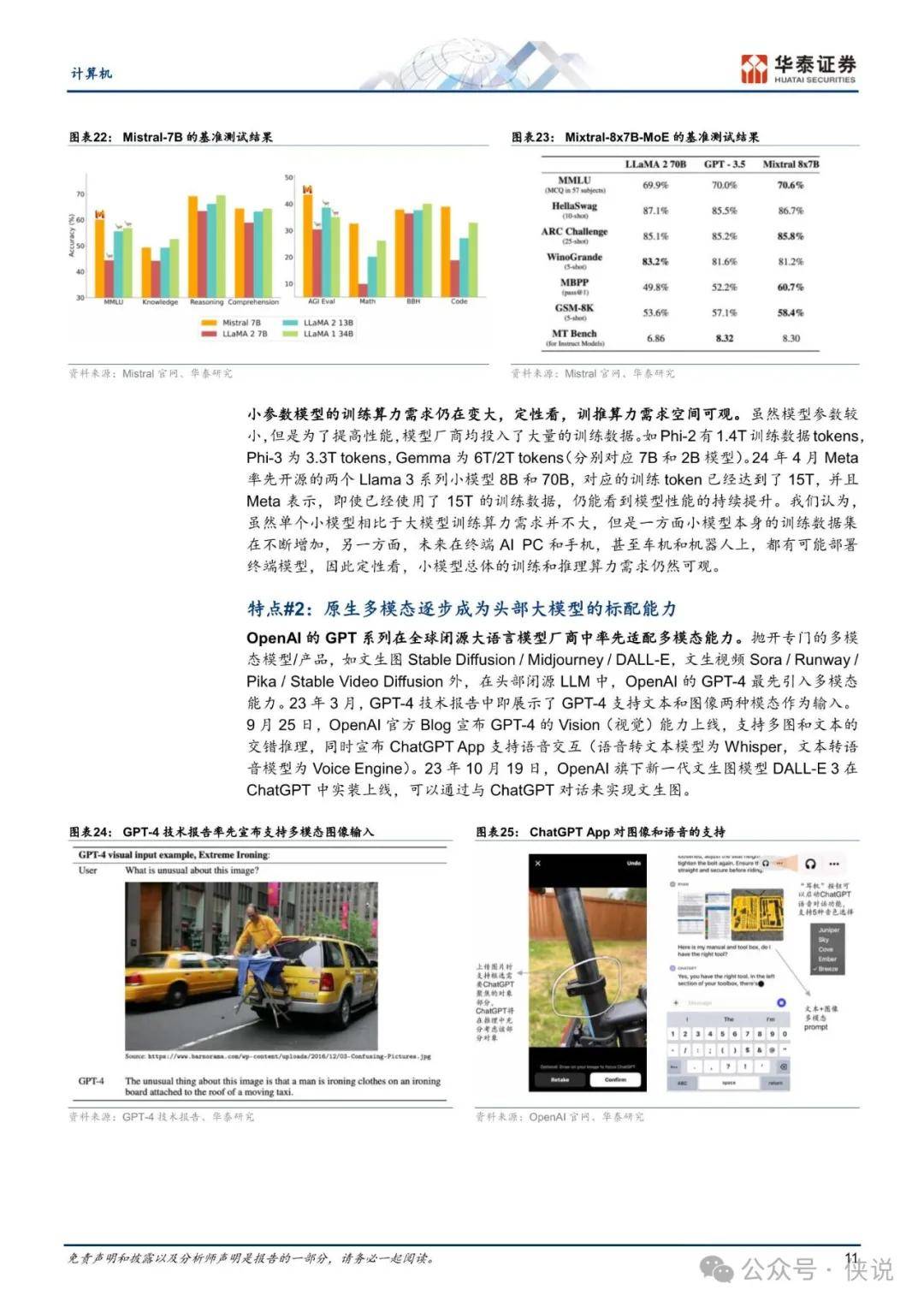

特点#1:大模型与小模型同步发展

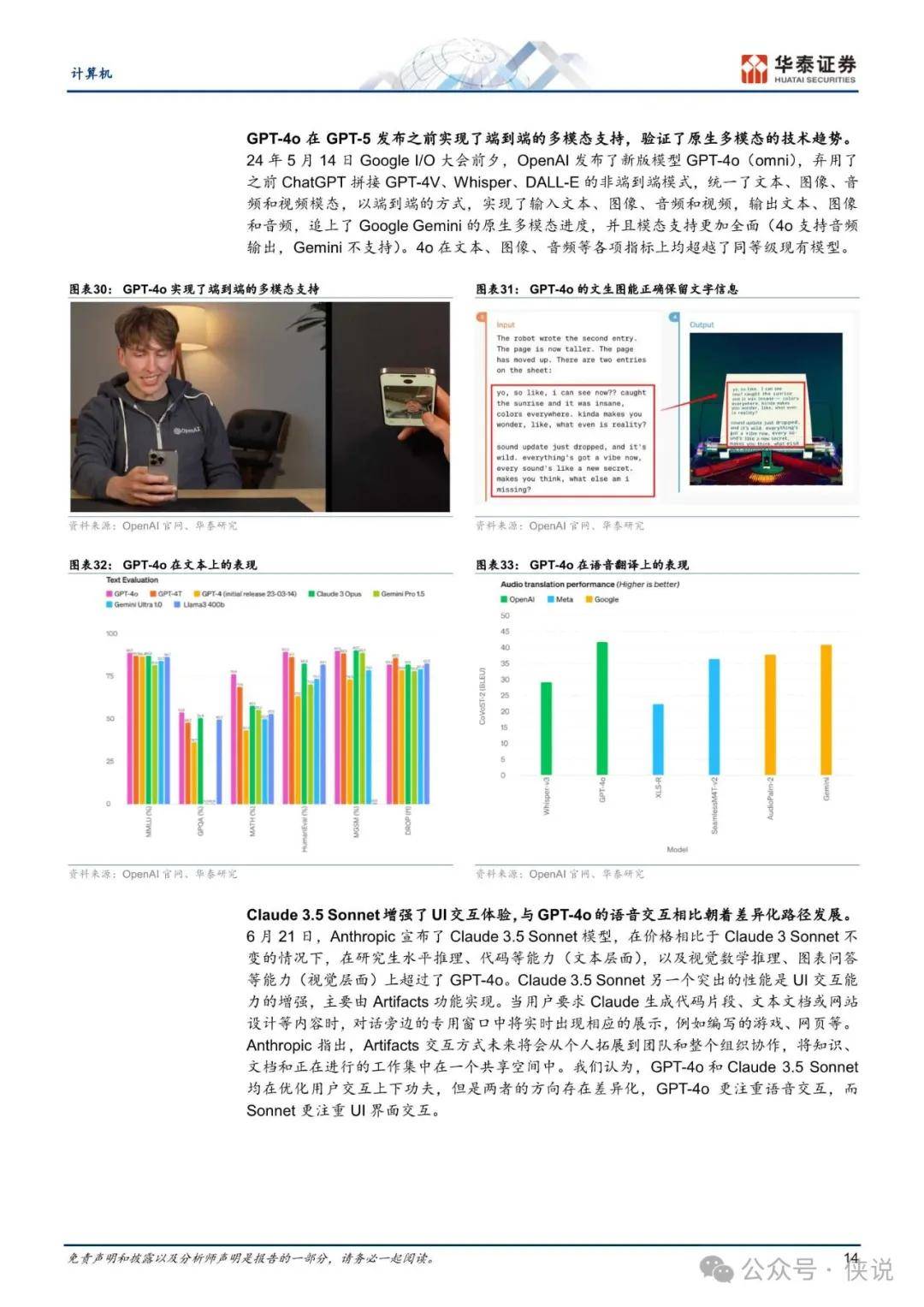

特点#2:原生多模态逐步成为头部大模型的标配能力

特点#3:上下文作为LLM的内存,是实现模型通用化的关键

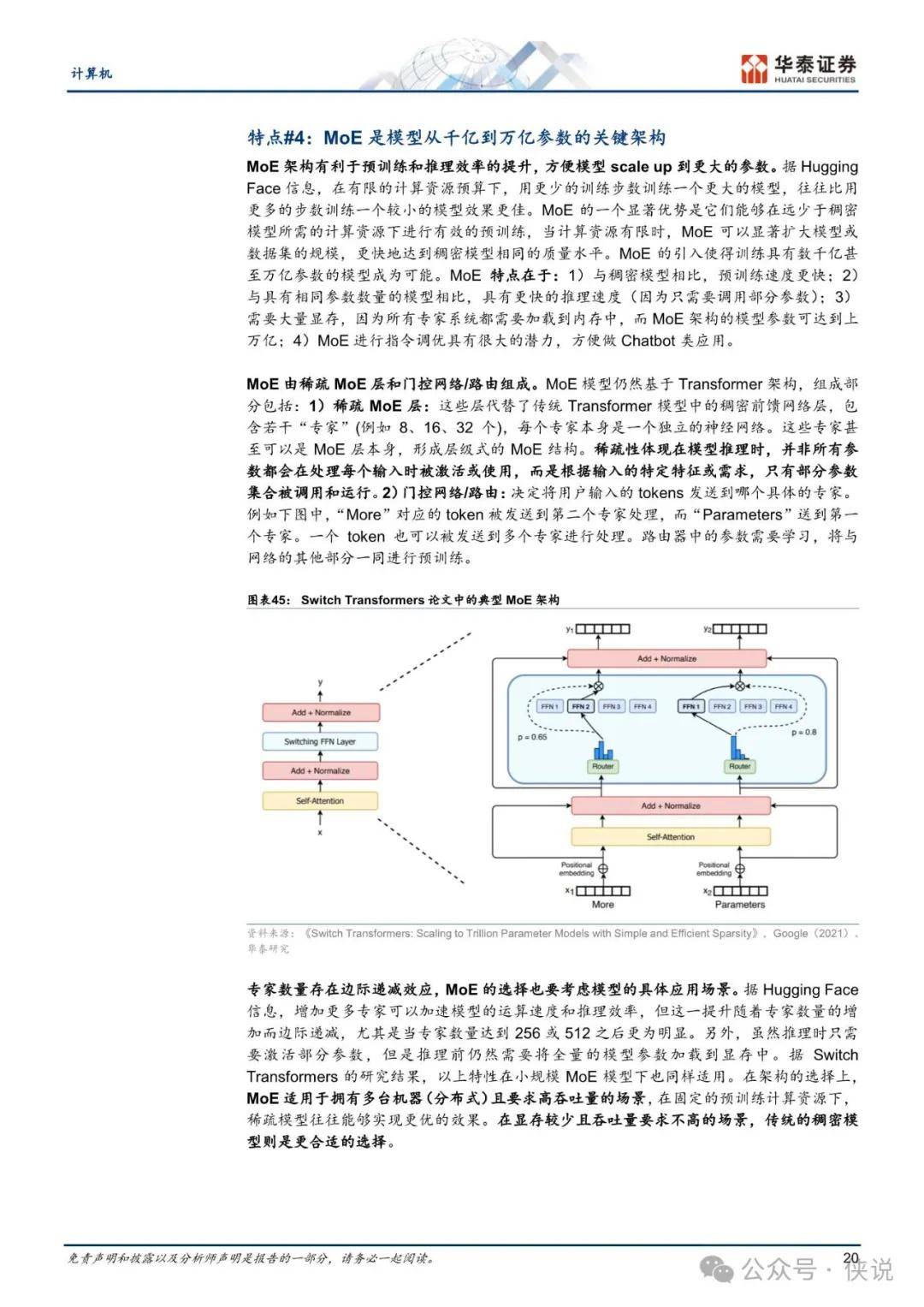

特点#4:MoE是模型从千亿到万亿参数的关键架构

大模型展望:Scaling Law + AI Agent + 具身智能

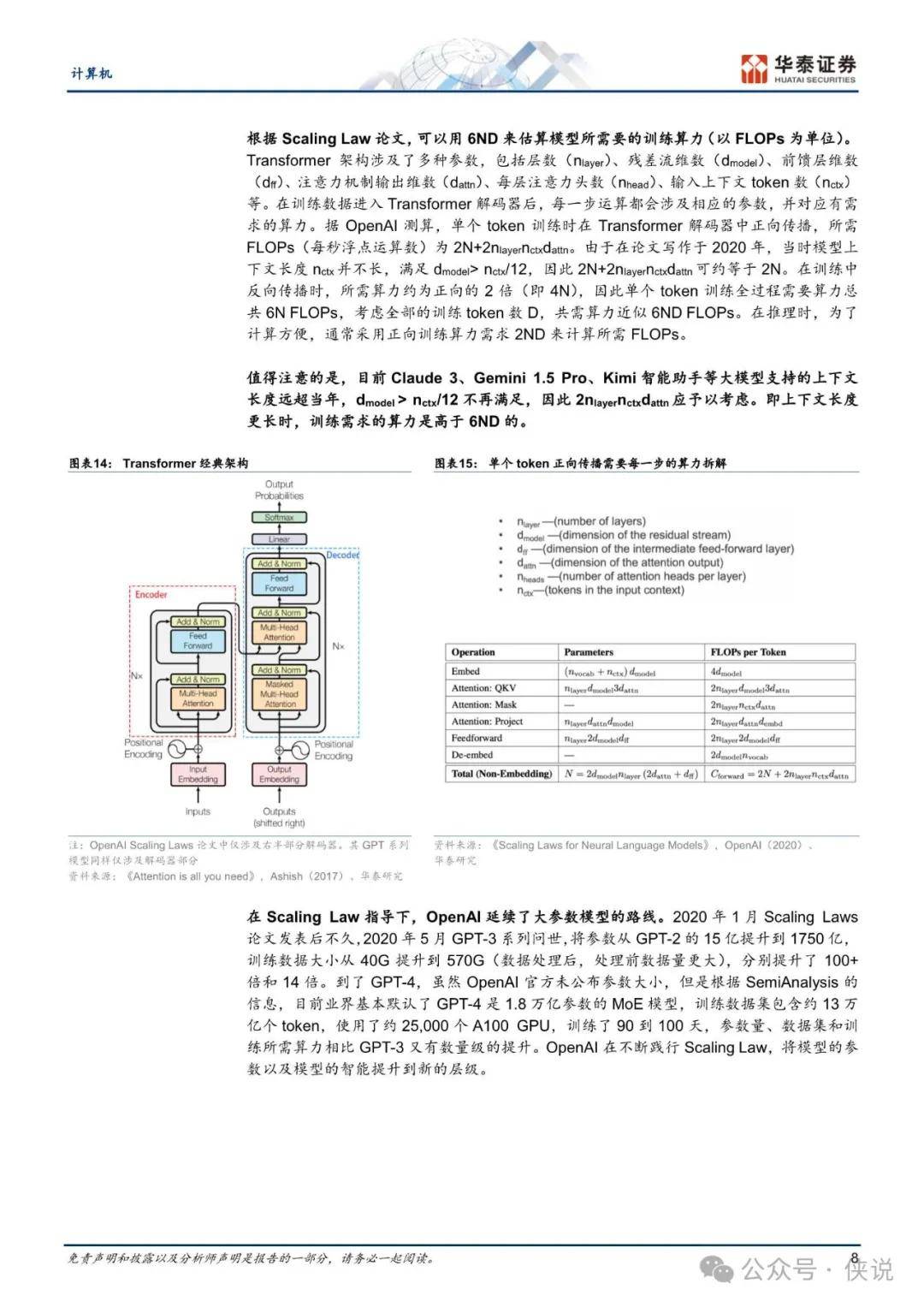

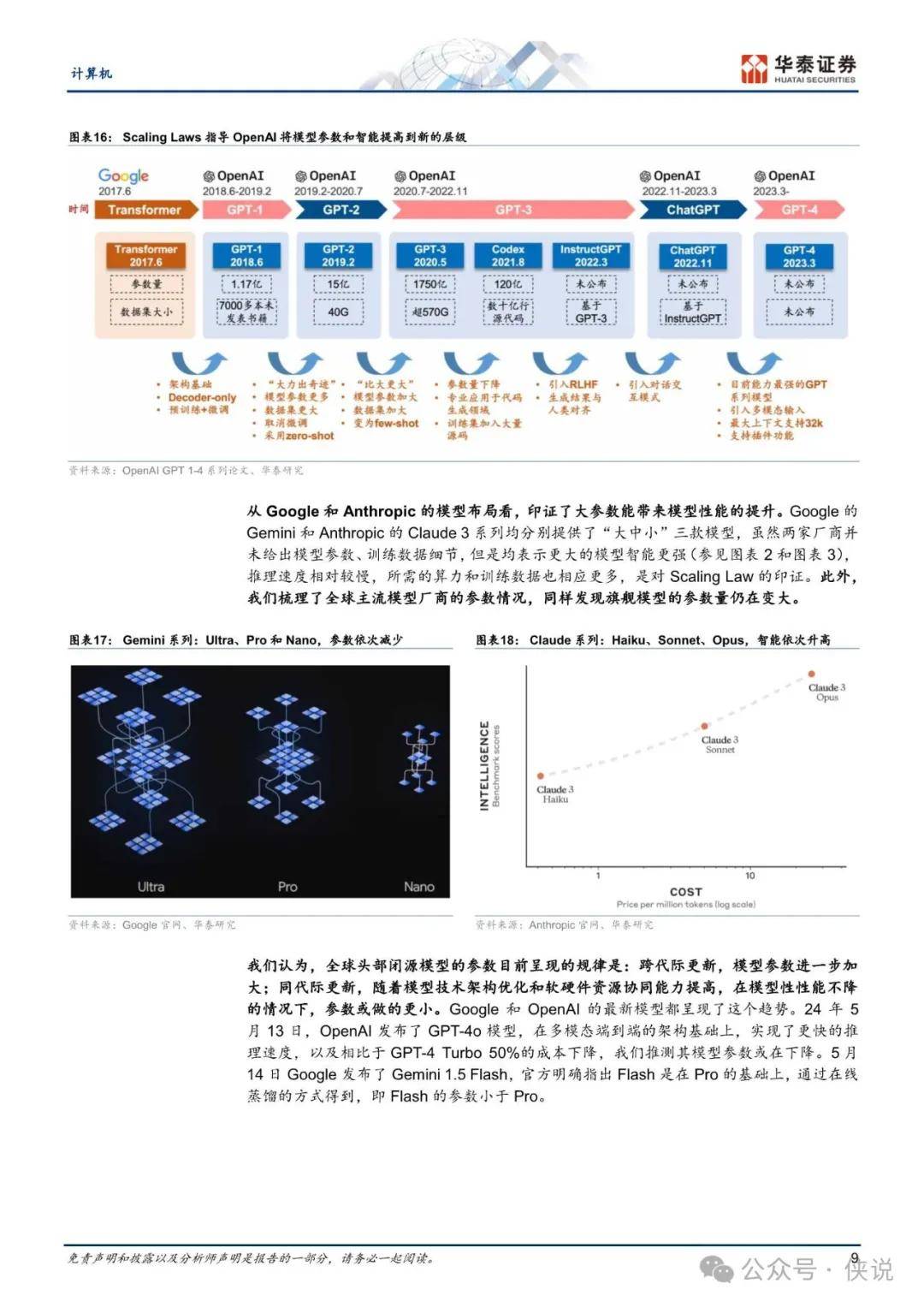

展望#1:Scaling Law理论上有边界,但是目前仍未到达

展望#2:模型幻觉短期难消除但可抑制,CoT是典型方法

展望#3:开源模型将在未来技术生态中占据一席之地

展望#4:数据将成为模型规模继续扩大的瓶颈,合成数据或是关键

展望#5:新的模型架构出现,但是Transformer仍是主流

展望#6:AI Agent智能体是AGI的加速器

展望#7:具身智能与LLM结合落地加速

GPT-5的几个预期

预期#1:MoE架构将延续,专家参数和数量或变大

预期#2:GPT-5及之后模型的训练数据集质量更高、规模更大

预期#3:在思维链CoT的基础上,再加一层AI监督

预期#4:支持更多外部工具调用的端到端模型

预期#5:多种大小不同的参数,不排除推出端侧小模型

预期#6:从普通操作系统到LLM操作系统

预期#7:端侧AI Agent将更加实用和智能

理想vs现实:从AI+到+AI

大模型产业链相关公司及主要逻辑

相关产业链公司梳理

相关产业链公司逻辑

国产大模型初创公司投融资情况

风险提示

报告部分内容节选如下: